作者|王乐妍

收拾一下|维克多

编辑|穆青

目前,大规模预训练模型在自然语言处理领域取得了巨大的成功。伯特、GPT-3等大型预训机型被视为“暴力美学”的一次胜利,验证了“机型越大,性能越好”的逻辑。行业内普遍形成了“提炼大模型”的竞争态势,国内研究机构和企业相继发布大规模预训练模型,呈现出百花齐放、百家争鸣的发展格局。这些模型的实际应用是什么?他们能解决什么实际问题?其他缺点是什么?2021年12月,平安科技前沿技术部负责人王乐妍在“行业共享:大规模预培训模式的商业应用与技术发展方向”CNCC 2021论坛上做了“大规模预培训模式在金融领域应用面临的主要问题及对策探讨”的报告。在报告中,他指出了当前垂直领域大规模前期培训模式的“致命”问题,并针对这些问题提出了平安科技的解决方案。

例如,他认为大规模预训练模型在垂直领域的性能达不到要求的原因可能是:“大规模预训练模型的训练语料非常庞大,既包含了本领域的关键信息,也包含了其他无关信息,使得模型缺乏对关键信息的关注”,“当前大规模预训练模型的机制改进很少涉及关键信息的提取”。

基于此,王乐妍认为,大规模的预训练模型本质上是在处理信号,但只要是信号,就可能被分解,将背景信息从垂直信息中分离出来,从而有效地拟合下游场景。

此外,金融客户对线上模型的准确性要求较高,直接使用预装模型往往难以满足很多场景的要求。王乐妍提出了置信度评估方法,并用强化学习和Bagging思想来评估模型的可靠性。

以下是演讲全文。《AI科技评论》在不改变初衷的情况下进行了整理。

本次分享的主题是“金融领域大规模预训练模型应用的主要问题及应对技术探讨”,主要以中国平安为例,从问题背景、语义空分解技术、置信度评估方法、应用等几个方面进行介绍。

任何人

问题背景

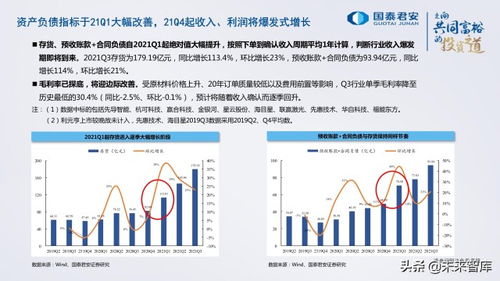

在平安公司的场景中,大规模预训模型在金融业务中的应用主要集中在贷款风险控制和股市投资。同时,这两个领域近几年的建模都会依赖于因子层面的大数据,比如文本信息。利用预训练模型进行处理,可以形成一些特征因素,便于分析和理解。

大规模预训练模型已经在数十个任务中使用,在医疗领域的表现更是令人瞠目结舌。但深入到金融领域,其性能仍然达不到要求。以选股为例。在信息获取阶段,传统的方法会从研究报告、雪球、知乎等论坛中人工搜索某家公司的信息和评论,再结合基金经理或投资者的判断,洞察该公司,从而决定是否买入。

由于金融领域容错性较低,要求模型对专业知识有较深的理解。如果不能达到一定的理解程度,从业者更倾向于不使用AI模型。

一般来说,对于单个任务,模型的性能可以达到90%,但是如果需要理解一段话或者专业评论,就需要三层模型形成一定的特征,然后模型的性能就会下降到70%左右。因此,在投资等要求严格的情况下,很难应用预培训模式。

为什么会出现这种问题?个人认为大规模预训练模型的语料是大文本,注重广度和背景,不太注重深度和细节。

以国内企业开发的一些预训练模型为例,其早期的改进方法都是侧重于面具层面,而Msak机制则倾向于侧重于学习信息的广度。当该模型应用于法律、医学等领域时。,更需要的是“深刻”的理解。

怎么解决?目前有很多想法,比如添加专家知识,知识强化,混合培训等等。目前,平安正在探索语义空分解技术和置信度评估方法。

注射毒品

语义空分解技术

那么,既然是信号,就可以分解。我们尝试了很多方法,其中一种是:在国内机构提出的大规模预训练模型的基础上,加入高、中、低滤波器,然后使用自适应谱机制进行处理,可以理解为一种注意机制,最后进入下游的任务训练。

实验表明,我们提出的谱分解网络结构,结合经典语言模型训练神经网络,可以显著提高语言模型在各类任务中的能力。

更具体地说,不仅在垂直领域,改进的语言模型在11个国际公开数据集上的测试结果比BERT模型高出3-20%。也证明了把语义空分离出来,然后再和下游的任务结合起来是通用的。

三

置信度评估方法

在金融领域,无论模型达到什么水平,它的上限永远是客户需求。比如客户的标准是95%的性能,而模型只能达到92%。只有3%的差异会让模型很难上线。这种问题在金融企业非常容易遇到。针对上述问题,平安科技提出了一种基于可信度评估的方法,通过该方法,模型可以评估其“可靠性”。如果可靠程度高,则通过;如果低,那么人类就需要直接接手或者放弃。因为在很多场景下,信息越多越好。信息冗余已经成为一个不容忽视的现象。

而且要解决围绕各种复杂经济主体的多源异构大数据难以统一表达,信息难以整体耦合关联的问题。平安通过数据标注抽取的置信度技术研究,提高了金融数据标注抽取的准确率和流程自动化水平;通过对经济学科多尺度、多维度语义关联表达技术的研究,构建金融领域知识图谱。

可靠性评估方法采用强化学习构建置信度框架。主要分为三部分:

1.用BERT等语言模型提取语义向量。

2.通过双向长时和短时记忆合并全局向量。

3.强化学习模块根据人工评分拟合相关标准,并输出置信度得分。

另外,你也可以尝试通过装袋来建立一个信心框架。模型管道有四个阶段:

1.利用Bagging思想,从数据中抽取5个样本,训练5组模型参数;

2.在少量测试集上测试每组参数的性能,根据F1值等性能分配各模型的置信度权重;

3.为每组参数选择一个标签后,在结果统计中累加相应的参数权重;

4、最后输出累积置信度最高标签。

四

技术应用

实验表明,改进后的语言模型在语义相似度、多分类、语义蕴涵等多种国际公开数据集上的测试准确率较高。比BERT模型提高了10%-20%,但召回率下降了20%-50%。在实际项目中,从舆情中提取公司标签的模型准确率提高了11个百分点,达到93%。

这在商业上很有价值。比如召回率虽然降低了50%,但这意味着只有一半的模型需要人工干预,另一半可以完全交给自动化,这远比模型不能上线要好。

在金融领域,比如选股,首先考虑的是模型的准确性,其他指标可以稍微差一点。比如模型只从1000只候选股票中选出50只好股票,可能会错过50只好股票。但是这种错过也是允许的。毕竟模型会“保证”选出的50只股票有大概率赚钱或者超额收益。

[/HR/]Leifeng.com·Leifeng.com